AIエージェントの業務利用が急速に拡大している。そこであらためて懸念されるようになったのが、AIリスクだ。

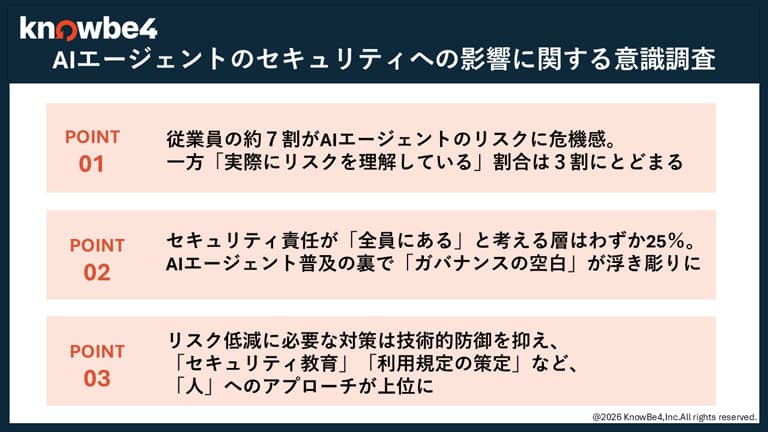

KnowBe4 Japanが3月31日に発表した「AIエージェントのセキュリティへの影響に関する意識調査」では、AIエージェントに対して期待が高まる一方、情報漏洩や著作権侵害といったヒューマンリスクへの懸念と、従業員のリスク理解の停滞という課題があらためて浮き彫りになった。

特に、リスク許容範囲の定義や予算・ルールの決定権限の所在が曖昧で「ガバナンスの空白」が生じている現状が明らかになった。

この調査によると、自組織ですでにAIエージェントを導入しているとの回答は40%に上り、今後の利用拡大を見込むとの回答も70%に上った。

そのなかで、AIエージェントの利用に伴うセキュリティリスクを「大きい」と認識している回答者の割合は68%となった。最も大きな懸念として挙げられたのは「機密情報の漏洩」で、次いで「著作権などの侵害」「ハルシネーション(誤情報の生成)」となった。いずれも人の判断や操作に起因するヒューマンリスクが上位を占めた。

また、AIエージェントを利用する際のセキュリティリスクを「従業員が理解している」と答えた回答者の割合は合計30%にとどまった。特に、AIエージェントを利用する際のセキュリティへの責任が、経営者、IT/セキュリティ部門、AIエージェントを使う従業員の「全員にある」と考える回答者はわずか25%にとどった。

AIを悪用したサイバー攻撃について、深刻化が懸念される攻撃としては「フィッシングメール/SMS」「ランサムウェア」「ビジネスメール詐欺(BEC)」がほぼ同数で上位に並んだ。ソーシャルエンジニアリング系攻撃のAIによる高度化への警戒感が強まっているとする。

AIエージェント利用に伴うリスク低減策としては、「セキュリティ教育・リテラシー教育の実施」「利用規定〔ポリシー〕の策定と周知」「エージェントへのアクセス制御の強化」の3つが多くを占めた。また、AIを悪用したサイバー攻撃への対応策としても「セキュリティ訓練/教育」が最多となった。技術的対策にとどまらず「人」へのアプローチを重視する傾向は昨年の調査から継続した。

KnowBe4では、調査から見える日本企業の課題として「教育組織がAIエージェントの普及に追いついていないこと」「ガバナンスの空白によって不測の事態に脆弱になっていること」「人の判断が最大の防御層(ヒューマン・ファイアウォール)であること」を挙げている。

【参考】:KnowBe4 Japan調査、AIエージェントに対する従業員のセキュリティ意識が明らかに | KnowBe4 Japan 合同会社のプレスリリース

ライター